Transfer Learning binnen Machine Learning; zelflerende algorithmes efficient toepassen en gebruiken

Computersystemen leren op een andere manier dan mensen. Een mens leert door eerdere ervaringen en kan deze ervaringen combineren om nieuwe taken uit te voeren. Bijvoorbeeld als je leert blokfluitspelen is het makkelijker om te leren klarinet spelen als dat je direct zou moeten leren klarinet te moeten spelen. Dit werkt niet zo voor een computersysteem.

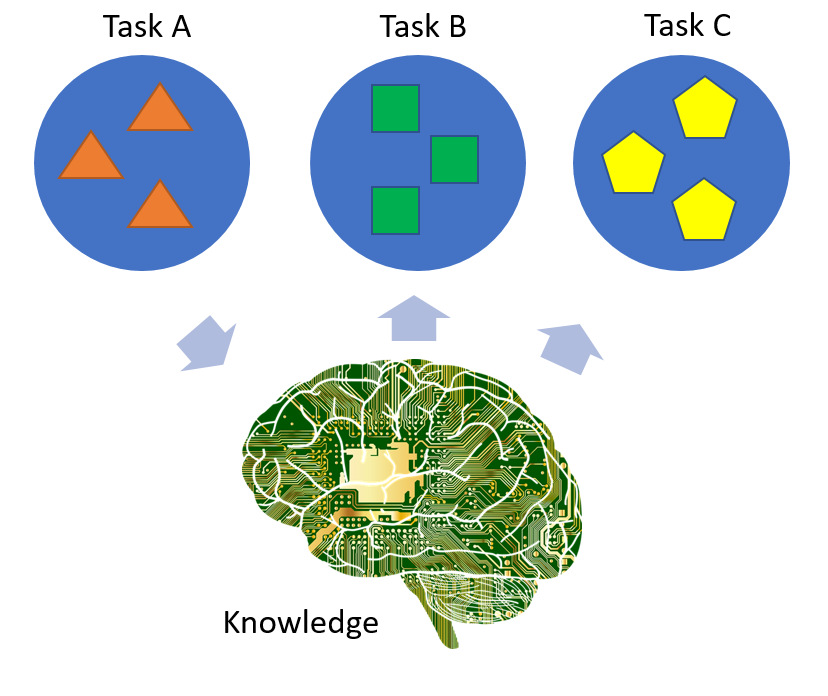

Algoritmes in een computersysteem leren vanaf de start, bijvoorbeeld het herkennen honden op plaatjes, is kennis die door het computersysteem alleen voor dit doel kan worden gebruikt. Transfer Learning is binnen Machine Learning het vakgebied die dit probeert op te lossen. Echter is dit in de praktijk veel lastiger dan men vaak denkt wat kan leiden tot inefficiëntie, een 'negative transfer'. Wanneer echter Transfer Learning efficiënt werkt kan dit leiden tot een hele grote intelligentie boost voor computeralgoritmes en worden ingezet op heel veel digitale vakgebieden. Bijvoorbeeld door hersentumoren in een vroeg stadium te herkennen of zelfrijdende auto's veiliger te maken.

Deze thesis gaat over het optimaliseren van Transfer Learning en hoe men voorkomt dat de Negative Transfer ontstaat. Het bevat een literatuuronderzoek en een aantal experimenten, binnen text mining, een vorm waarin door mensen geschreven tekst door het computersysteem geanalyseerd wordt. De conclusies van het onderzoek zijn dat Transfer Learning efficiënt is wanneer de datasets met gelijke woordenset een grotere kans op positive transfers hebben, daarnaast blijkt de vorm van transferen relevant en is het te gebruiken algoritme van invloed op de effectiviteit.